ما هو الـ (Deepfake)؟

يشير مصطلح (Deepfake) إلى مقاطع الفيديو أو الصور التي عُدِّلَت باستخدام خوارزميات الذكاء الاصطناعي لتبديل الوجوه أو الأصوات بما يجعل المحتوى يبدو حقيقياً. يستند المصطلح إلى كلمتين: (Deep Learning) "التعلم العميق" و(Fake) "مزيف"، وهو يجمع بينهما ليصف محتوى مزوَّر وُلِّدَ بالاعتماد على الشبكات العصبية العميقة. يُستخدم الـ (Deepfake) في مجالات الترفيه، وصناعة السينما، والإعلانات، لكنَّه أيضاً أداة خطيرة حين يُستغل في التضليل الإعلامي أو الابتزاز الإلكتروني.

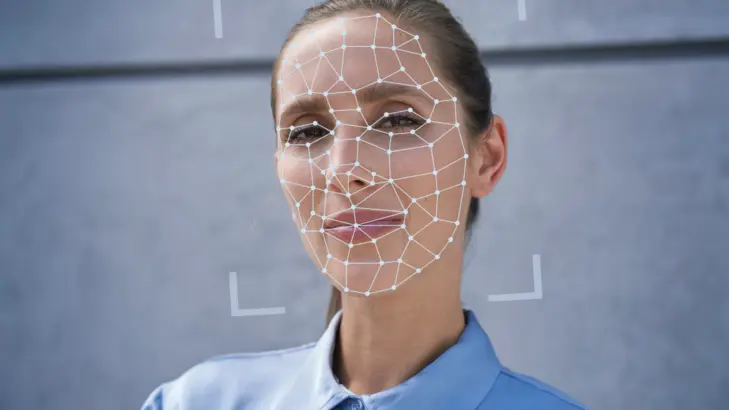

كيف يعمل الـ (Deepfake)؟

تعتمد تقنية (Deepfake) على الذكاء الاصطناعي وتحديداً على خوارزميات التعلُّم العميق (Deep Learning) التي تحلل آلاف الصور والفيديوهات لتتعلم كيف تتحرك ملامح الوجه والصوت والإيماءات البشرية بدقة. يُدرَّب النموذج الذكي على محاكاة هذه الحركات، ثم يُستخدم لاستبدال وجه شخص بآخر داخل فيديو موجود مسبقاً بما يجعل النتيجة تكاد تكون مطابقة للواقع. تُنفَّذ العملية من خلال الشبكات العصبية التوليدية (GANs)، وهي نوع من الخوارزميات التي تتكوَّن من شبكتين:

- تُنشِئ الأولى الصورة المزيفة.

- تتحقق الثانية من مدى واقعيتها حتى يوصَل إلى النتيجة الأعلى إقناعاً.

النتيجة النهائية هي فيديو يبدو حقيقياً في المظهر والحركة والصوت، لكنه في الواقع مصطنع بالكامل وهذا ما يجعل تقنية الـ (Deepfake) مثيرة للقلق والخطورة في آنٍ واحد.

الفرق بين الفيديوهات الأصلية والمزيفة

لم يعد التمييز بين الفيديو الحقيقي والمزوَّر سهلاً كما في الماضي، ومع ذلك، توجد فروقات دقيقة يمكن الانتباه إليها:

- الحركة الدقيقة للعين: قد تبدو نظرات العين في الفيديوهات المزيَّفة غير طبيعية أو غير متزامنة مع المشهد.

- تزامن الشفاه مع الصوت: لا تتطابق حركة الفم مع الكلمات المنطوقة أحياناً، خصيصاً عند تغيُّر الإضاءة أو الزوايا.

- الظلال والإضاءة: قد يظهر الوجه بإضاءة مختلفة عن الخلفية أو الجسد، مما يشير إلى أنَّه مدموج رقمياً.

- الانفعالات الدقيقة: تحتوي ملامح الوجه الحقيقية على تفاصيل صغيرة، مثل التجاعيد الدقيقة في التعبير، بينما تتجاهلها بعض نماذج (Deepfake).

- التحليل التقني: يمكن لاستخدام برامج كشف الفيديوهات المزيفة، مثل (Deepware Scanner) أو (Sensity AI) أن يحدد بدقة نسبة التلاعب في المحتوى.

مع التطور المستمر في الذكاء الاصطناعي، تقلُّ هذه الفروقات شيئاً فشيئاً، ما يجعل من الصعب اكتشاف المقاطع المزيَّفة دون أدوات تحليل متخصصة.

خطوات إنتاج فيديو (Deepfake)

رغم أنَّ النتيجة النهائية، تبدو بسيطة، إلَّا أنَّ إنتاج فيديو (Deepfake) يمر بعدة مراحل تقنية دقيقة:

- جمع البيانات: يجمع منشئ الفيديو صوراً وفيديوهات للشخص المستهدف من زوايا متعددة، غالباً من وسائل التواصل الاجتماعي أو المقاطع العامة.

- تدريب نموذج الذكاء الاصطناعي: تُستخدم هذه البيانات لتدريب خوارزمية (Deep Learning) على التعرُّف على ملامح الوجه، وتعبيراته، وحركاته الطبيعية.

- الاستبدال الرقمي: يُستبدَل وجه الشخص الأصلي في الفيديو بعد التدريب بوجه الشخص المستهدف باستخدام تقنية (Face Swapping)، مع الحفاظ على الإيماءات والإضاءة الأصلية.

- تحسين جودة الصوت: في بعض الحالات، يُولَّد أيضاً صوت مزيف باستخدام تقنية (Voice Deepfake) التي تحلل نبرة المتحدث الحقيقية وتكرِّرها رقمياً.

- المعالجة النهائية (Post-processing): تُجرى تعديلات دقيقة على الظلال، والإضاءة، وتناسق المشهد لجعل الفيديو يبدو واقعياً تماماً ولا يمكن تمييزه عن الحقيقي.

مخاطر الفيديوهات المزيَّفة على الإنترنت

تتزايد خطورة الفيديوهات المزيفة (Deepfake) مع تطور الذكاء الاصطناعي وقدرته على تقليد الوجوه والأصوات بدقة شبه تامة. لم تقتصر المشكلة على الخداع البصري فحسب؛ بل أصبحت تهدد الثقة الرقمية والأمن المعلوماتي وحتى الاستقرار الاجتماعي.

في ما يلي، أبرز المخاطر التي تفرضها هذه التقنية على الأفراد والمجتمعات:

1. التضليل الإعلامي ونشر الأخبار الكاذبة

يُعد هذا أخطر استخدام للفيديوهات المزيفة؛ إذ يمكن إنشاء مقاطع لأشخاص معروفين، سياسيين أو إعلاميين وهم يدلون بتصريحات لم تصدر عنهم أصلاً. تنتشر هذه المقاطع بسرعة على وسائل التواصل الاجتماعي، مما يؤثر في الرأي العام ويخلق انقسامات اجتماعية أو سياسية حادة.

2. الابتزاز الإلكتروني وانتهاك الخصوصية

يستخدم بعض القراصنة تقنية (Deepfake) لدمج صور أشخاص في مشاهد غير لائقة أو محرجة بهدف تشويه السمعة أو الابتزاز المالي، وغالباً ما تستهدف هذه الهجمات الأفراد العاديين، وليس فقط المشاهير، مما يجعل حماية الهوية الرقمية ضرورة أساسية لكل مستخدم.

3. الاحتيال المالي وانتحال الهوية

يُستخدَم (Deepfake) في عالم الشركات لتقليد صوت أو وجه أحد المدراء التنفيذيين لإصدار أوامر تحويل مالية مزيفة، وقد سُجِّلَت حالات حقيقية لخسائر بملايين الدولارات نتيجة هجمات تعتمد على الصوت أو الفيديو المزيف في بيئات العمل.

4. تراجع الثقة في وسائل الإعلام والمحتوى الرقمي

يشكُّ المستخدمون مع انتشار الفيديوهات المزيفة في صحة كل ما يشاهدونه على الإنترنت. يضر هذا التراجع في الثقة بالمؤسسات الإعلامية ويزيد صعوبة التحقق من الحقائق، ما يؤدي إلى بيئة معلوماتية مليئة بالشكوك.

أمثلة عن جرائم (Deepfake) حول العالم

شهد العالم عدة حوادث أظهرت خطورة الفيديوهات المزيفة:

- في السياسة: انتشرت مقاطع مزيفة لقادة دول يتحدثون بتصريحات لم تصدر عنهم، ما أثار أزمات دبلوماسية مؤقتة.

- في الشركات: استخدم محتالون في 2023 تقنية الـ (Deepfake) لانتحال صوت مدير تنفيذي لإقناع موظف بتحويل مبلغ ضخم إلى حساب مزيف.

- في الإعلام: تداولت مواقع التواصل فيديوهات مفبركة لمشاهير في مواقف غير حقيقية، مما أضر بسمعتهم وأثار جدلاً حول أخلاقيات الذكاء الاصطناعي.

تُبرز هذه الحوادث كيف يمكن لاستخدام الذكاء الاصطناعي في الجريمة الإلكترونية أن يتحول من مجرد تقنية إلى تهديد حقيقي للأمان الرقمي والمجتمعي.

الأسئلة الشائعة

1. كيف تواجَه مخاطر (Deepfake)؟

تواجَه هذه التقنية من خلال تطوير أدوات كشف تعتمد على الذكاء الاصطناعي المعاكس، وتعزيز التوعية الرقمية لدى المستخدمين، وتشديد القوانين على من ينشر أو يستخدم الفيديوهات المزيفة لأغراض خبيثة.

2. كيف تُكشَف فيديوهات الـ (Deepfake)؟

عادةً ما تظهر مؤشرات صغيرة، مثل عدم تزامن الشفاه، أو نظرات عين غير طبيعية، أو تباين في الإضاءة والظلال. كما يمكن استخدام أدوات، مثل (Deepware Scanner) أو (Sensity AI) لاكتشاف المحتوى المزيف بدقة.

في الختام

تمثل تقنية (Deepfake) وجهين لعصر الذكاء الاصطناعي: الإبداع والابتكار من جهة، والمخاطر والتضليل من جهة أخرى، وبينما يمكن الاستفادة منها في السينما أو التعليم، تبقى الحاجة ملحَّة لوضع ضوابط وتشريعات تحمي الأفراد والمجتمعات من إساءة استخدامها، فكلما أصبح العالم أكثر رقمية، ازدادت أهمية الوعي والتمييز بين الحقيقي والمزيف.

أضف تعليقاً