يمكن تصنيف الذكاء الاصطناعي على أنه إما ضعيف أو قوي:

- الذكاء الاصطناعي الضعيف: المعروف أيضاً باسم الذكاء الاصطناعي الضيّق، هو نظام الذكاء الاصطناعي الذي تمَّ تصميمه وتدريبه لمهمة معينة فقط. فمثلاً "المساعدين الشخصيين الافتراضيين" (Virtual personal assistants)، مثل نظام أبل سيري Apple Siri (نظام الأوامر الصوتية الخاص باجهزة أبل)، يعتبر شكل من أشكال الذكاء الاصطناعي الضعيف.

- الذكاء الاصطناعي القوي: المعروف أيضاً باسم الذكاء العام الاصطناعي، فهو نظام الذكاء الاصطناعي ذو القدرات المعرفية البشرية المُعَمَّمَة. فعند تقديم مهمة غير مألوفة له من قبل، يكون نظام الذكاء الاصطناعي القوي قادراً على إيجاد حل دون تدخل بشري.

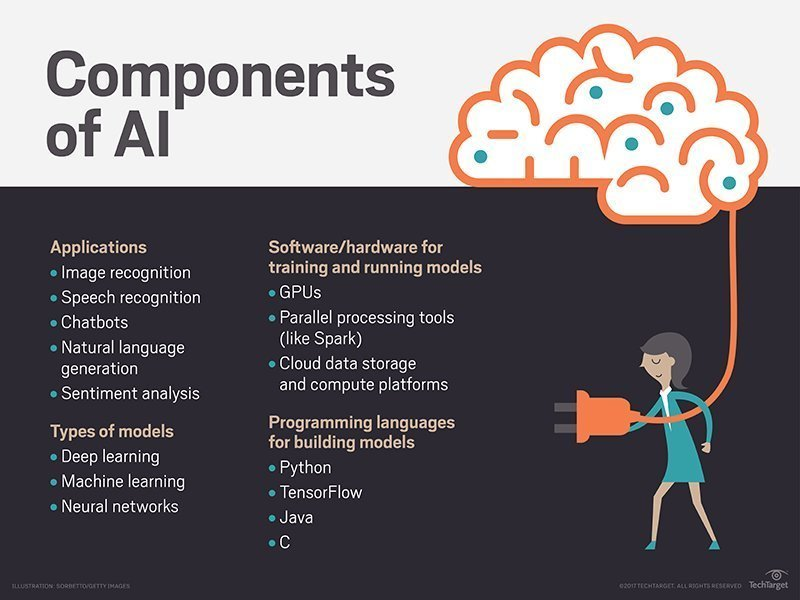

نظراً لأن تكاليف الأجهزة والبرامج والموظفين الخاصة بالذكاء الاصطناعي قد تكون باهظة الثمن، فإن العديد من البائعين يدرجون مكونات الذكاء الاصطناعي في عروضهم القياسية، بالإضافة إلى الوصول إلى منصات "الذكاء الاصطناعي كخدمة سحابية" (AIaaS). تسمح أنظمة "الذكاء الاصطناعي كخدمة سحابية" (AIaaS) لكل من الأفراد والشركات بتجربة استخدام الذكاء الاصطناعي لأغراض تجارية مختلفة وللعديد من المنصّات قبل شراء الخدمة. أشهر الشركات التي تقدّم خدمات الذكاء الاصطناعي السحابية:

- خدمات الذكاء الاصطناعي من أمازون Amazon AI.

- مساعد أي بي إم واتسون IBM Watson Assistant.

- الخدمات المعرفية من مايكروسوفت Microsoft Cognitive Services.

- خدمات الذكاء الاصطناعي من جوجل Google AI Services.

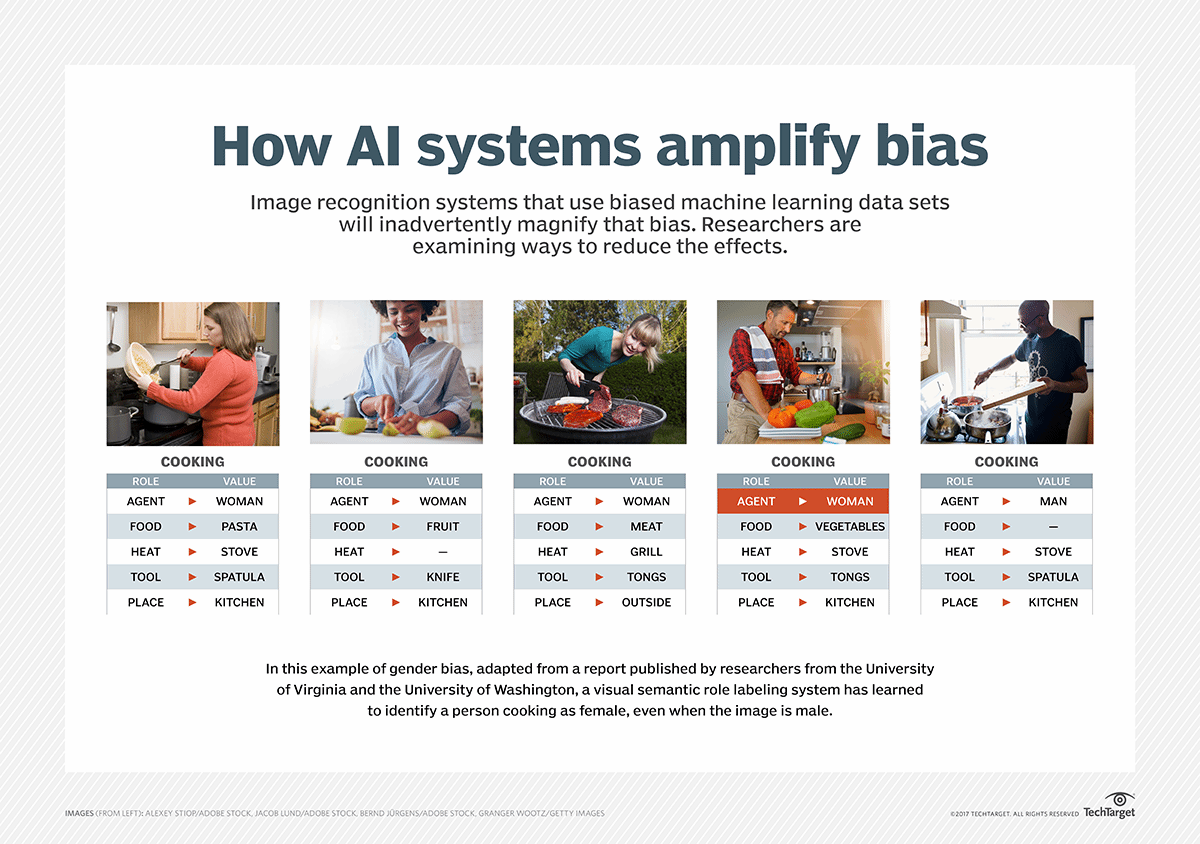

في الوقت الذي تُقَدّم فيه أدوات الذكاء الاصطناعي مجموعة من الوظائف الجديدة للشركات، فإنّ استخدام الذكاء الاصطناعي يثير أسئلة أخلاقية. وذلك لأن خوارزميات "التعلّم العميق" (Deep Learning)، التي تدعم العديد من أدوات الذكاء الاصطناعي الأكثر تطوراً، هي فقط ذكية بالمقدار من البيانات التي يتم تزويدها به أثناء التدريب. ونظراً لأن الإنسان هو من يختار البيانات التي يجب استخدامها لتدريب برنامج الذكاء الاصطناعي، فإن احتمالات التحيّز البشري متأصّلة ويجب مراقبتها عن كثب.

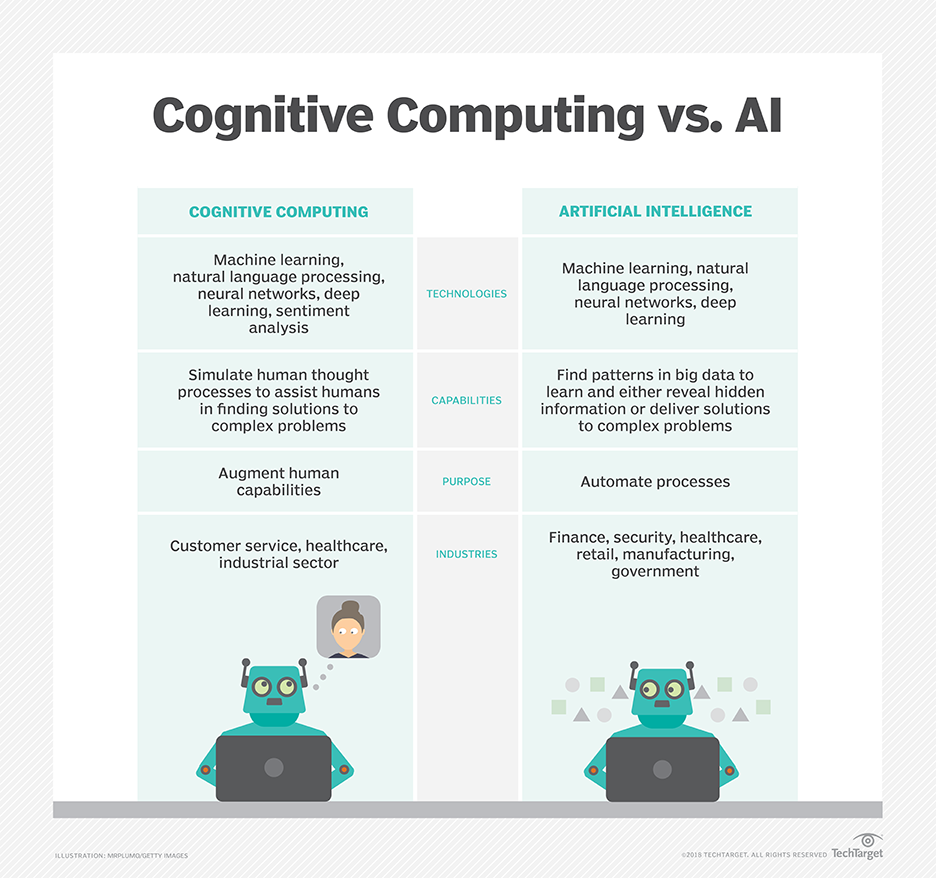

يعتقد بعض خبراء الصناعة أنّ مصطلح "الذكاء الاصطناعي" يرتبط ارتباطاً وثيقاً بالثقافة الشعبية أو العامة، مما يجعل عامة الناس لديهم مخاوف غير واقعية حول الذكاء الاصطناعي، وتوقّعات غير محتملة حول كيفية تغيير الذكاء الاصطناعي لأماكن العمل أو حتى تغييره للحياة بشكل عام. يأمل الباحثون والمسوّقون من خلال مفهوم "الذكاء المعزز" (augmented intelligence)، والذي له دلالة أكثر حيادية، أن يُساعِد هذا المفهوم الناس على فهم أن "الذكاء الاصطناعي" سوف يُحَسّن المنتجات والخدمات ببساطة، وأنّ الذكاء الاصطناعي هو ليس بديلاً عن البشر الذين يستخدمونه.

أنواع الذكاء الاصطناعي:

أرند هينتز، أستاذ مساعد في علم الأحياء التكاملي وعلوم هندسة الكمبيوتر في جامعة ولاية ميشيغان، يُصنّف الذكاء الاصطناعي إلى أربعة أنواع، بدءاً من نوع أنظمة الذكاء الاصطناعي الموجودة حالياً إلى الأنظمة التي لا وجود لها بعد. فئاته هي كما يلي:

- النوع الأوّل، آلات رد الفعل (Reactive machines): مثال على ذلك، حاسوب ديب بلو (Deep Blue)، هو برنامج الشطرنج من شركة IBM الذي تغلّب على غاري كاسباروف (Garry Kasparov) في التسعينيات. يمكن لـ Deep Blue التعرف على القطع الموجودة على لوحة الشطرنج وإجراء تنبؤات، ولكنه لا يحتوي على ذاكرة وبالتالي لا يمكنه استخدام التجارب السابقة لإبلاغ وتعليم التجارب المستقبلية. يحلل التحركات المحتملة -له ولخصمه- ويختار الخطوة الأكثر استراتيجية. تم تصميم كلاً من "Deep Blue" و"جوجل الفا غو" (Google's AlphaGO) لأغراض ضيّقة ومحدّدة، ولا يمكن توظيفهما بسهولة في مجالات أخرى غير التي صُمّمَا لأجلها.

- النوع الثاني، ذاكرة محدودة (Limited Memory): يمكن لأنظمة الذكاء الاصطناعي هذه استخدام الخبرات السابقة لتوجيه وتعليم القرارات المستقبلية. تمّ تصميم بعض وظائف "صنع القرار" (Decision-making) في السيارات ذاتية القيادة بهذه الطريقة. في هذا النوع تقوم "المُرَاقبات" (Observations) بالإبلاغ عن الإجراءات التي تحدث في المستقبل القريب، مثل ممرات تغيير خط السير للسيارة. لا يتم تخزين هذه الملاحظات والمُرَاقَبَات بشكل دائم.

- النوع الثالث، نظرية العقل (Theory of mind): يشير مصطلح علم النفس هذا إلى فهم أن لدى الآخرين معتقداتهم، ورغباتهم الخاصة، والنوايا، وجميعها تؤثر على القرارات التي يتخذونها. هذا النوع من الذكاء الاصطناعي غير موجود بعد.

- النوع الرابع، الوعي الذاتي (Self-awareness): في هذه الفئة، يكون لدى أنظمة الذكاء الاصطناعي شعور بالذات ولديها وعي ذاتي أيضاً. تتفهّم الآلات المزوّدة بالوعي الذاتي الحالة الحالية التي هي فيها، ويمكنها استخدام هذه المعلومات لاستنتاج ما يشعر به الآخرون. هذا النوع من الذكاء الاصطناعي غير موجود بعد أيضاً.

أمثلة على تقنيات الذكاء الاصطناعي AI:

تم دمج الذكاء الاصطناعي في مجموعة متنوعة من أنواع التكنولوجيا المختلفة. هنا سبعة أمثلة:

- الأتمتة (Automation): ما الذي يجعل النظام أو عملية ما تعمل تلقائياً. على سبيل المثال، يمكن برمجة "أتمتة العمليات الآلية" (RPA) لأداء مهام كبيرة الحجم وقابلة للتكرار والتي عادةً يؤديها الإنسان. يختلف RPA عن "أتمتة تقنية المعلومات" (IT Automation) من حيث أنه يمكنه التكيّف مع الظروف المتغيرة.

- تعلّم الآلة (Machine Learning): هو العلم الذي يُمَكّن جهاز كمبيوتر من العمل والتصّرف دون برمجة. في الواقع إنّ "التعلّم العميق" (Deep Learning) عبارة عن مجموعة فرعية من "تعلّم الآلة" (Machine Learning)، والتي بعبارات بسيطة للغاية يمكن اعتبارها أتمتة "للتحليلات التنبؤية" (predictive analytics). هناك ثلاثة أنواع من خوارزميات "تعلّم الآلة":

- التعلم الخاضع للإشراف (Supervised Learning): يتم تصنيف مجموعات البيانات (Data sets) بحيث يمكن اكتشاف الأنماط (patterns) واستخدامها لتصنيف مجموعات البيانات الجديدة.

- التعلم بدون إشراف (Unsupervised Learning): لا يتم تصنيف مجموعات البيانات، وإنّما يتم ترتيبها وفقاً لأوجه التشابه أو وفقاً لأوجه الاختلافات.

- التعلم المُعَزّز (Reinforcement Learning): لا يتم تصنيف مجموعات البيانات، ولكن بعد تنفيذ إجراء ما أو عدة إجراءات، يتم إعطاء وتغذية نظام الذكاء الاصطناعي بنتائج من تغذية راجعة (Feedback).

- رؤية الآلة (Machine Vision): وهو علم السّماح لأجهزة الكمبيوتر بالرؤية. تلتقط هذه التقنية المعلومات المرئية وتحللها باستخدام عدة أدوات وهي "الكاميرا"، ومحوّل "رقمي إلى تناظري" و"معالج الإشارات الرقمية". وغالباً ما تتم مقارنته ببصر الإنسان، لكن "رؤية الآلة" (machine Vision) غير مرتبطة بالبيولوجيا (كما هو الحال في الإنسان)، ويمكن برمجتها للرؤية من خلال الجدران. على سبيل المثال، يتم استخدام "رؤية الآلة" في مجموعة من التطبيقات بدءاً من التعرّف على تواقيع الإنسان وصولاً إلى تحليل الصور الطبية. غالباً ما ترتبط "رؤية الكمبيوتر" (Computer Vision) والتي تركّز على معالجة الصور بالاعتماد على الآلة مع "رؤية الآلة" (Machine Learning).

- معالجة اللغات الطبيعية (NLP - Natural language processing): وهي معالجة لغة الإنسان -وليس الحاسوب- بواسطة برنامج كمبيوتر. أحد أقدم وأشهر أمثلة "معالجة اللغات الطبيعية" هو اكتشاف رسائل البريد الإلكتروني غير المرغوب فيها أو ما يسمّى Spam أو Junk، حيث يقوم البرنامج بالنظر إلى سطر موضوع الرسالة وأيضاً إلى نص رسالة البريد الإلكتروني ويقرر ما إذا كان بريد غير هام (Junk). تعتمد الأساليب الحالية في "معالجة اللغات الطبيعية" على "تعلم الآلة" (Machine Learning). وتتضمن مهام "معالجة اللغات الطبيعية" كلاً من ترجمة النصوص، وتحليل المشاعر، والتعرف على الكلام (Speech Recognition).

- الروبوتات (Robotics): هو مجال من الهندسة يُرَكّز على تصميم وتصنيع الروبوتات. غالباً ما تستخدم الروبوتات لأداء المهام التي يصعب على البشر القيام بها أو القيام بها باتّساق (بنفس الانتظام والدقّة). يتم استخدامها في خطوط الإنتاج لتجميع السيارات أو بواسطة ناسا لنقل الأشياء الكبيرة في الفضاء. يستخدم الباحثون أيضاً "تعلّم الآلة" لبناء الروبوتات التي يمكن أن تتفاعل في البيئات الاجتماعية.

- السيارات ذاتية القيادة (Self-driving cars): تستخدم مزيجاً من "رؤية الكمبيوتر" (Computer Vision)، وتقنيات "التعرّف على الصور"، و"التعلّم العميق" (Deep Learning) لبناء مهارة آلية في قيادة مركبة أثناء البقاء في مسرب قيادة (Driving Lane) معيّن، وتَجَنُّب العوائق غير المتوقعة، مثل المشاة.

تطبيقات الذكاء الاصطناعي:

لقد شقّ الذكاء الاصطناعي طريقه إلى عدد من الساحات والمجالات. هنا ستة أمثلة:

- الذكاء الاصطناعي في مجال الرعاية الصحية (AI in healthcare): إنّ أكبر المراهنات في مجال الذكاء الاصطناعي هو في تحسين نتائج المرضى وخفض التكاليف. تقوم الشركات بتطبيق تقنيات "تعلّم الآلة" لإجراء تشخيصات بشكل أفضل وأسرع من البشر. أحد أكثر تقنيات الرعاية الصحية شهرةً هو "أي بي إم واتسون" (IBM Watson). إنّ النظام الكمبيوتري هذا يفهم اللغة الطبيعية وهو قادر على الإجابة على الأسئلة المطروحة. حيث يقوم باستخراج نظام بيانات المرضى ومصادر البيانات الأخرى المتاحة لتشكيل فرضيّة، والتي يُقدّمُهَا بعد ذلك مع مخطط تسجيل الثقة. يتضمن واتسون تطبيقات "ذكاء اصطناعي" أخرى مثل "روبوتات الدردشة" (Chatbots)، وهو برنامج كمبيوتر يُسْتَخْدَم عبر الإنترنت للإجابة على الأسئلة ومساعدة العملاء، وللمساعدة في جدولة مواعيد المتابعة أو مساعدة المرضى من خلال عملية إعداد الفواتير، و"مساعدين صحيين افتراضيين" يقدمون ملاحظات طبيّة أساسية.

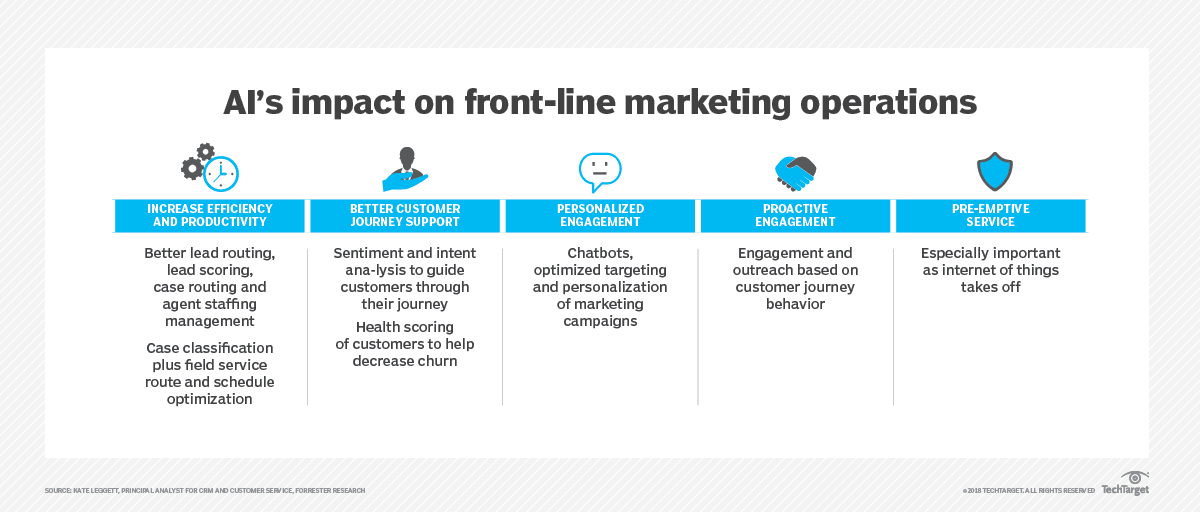

- الذكاء الاصطناعي في العمل (AI in business): يتم تطبيق أتمتة العمليات الآلية على المهام المتكررة للغاية التي يؤديها عادة البشر. يتم دمج خوارزميات "تعلّم الآلة" في التحليلات ومنصات "إدارة علاقات العملاء" (CRM) للكشف عن معلومات حول كيفية تقديم خدمة أفضل للعملاء. تم دمج "روبوتات الدردشة" (Chatbots) في مواقع الويب لتقديم خدمة فورية للعملاء. أصبحت أتمتة المناصب الوظيفية نقطة نقاش بين الأكاديميين ومحللي تكنولوجيا المعلومات.

- الذكاء الاصطناعي في التعليم (AI in Education): يمكن للذكاء الاصطناعي أتمتة نظام الدرجات التعليمي وبالتالي إعطاء المعلمين المزيد من الوقت. يمكن للذكاء الاصطناعي تقييم الطلاب والتكيّف مع احتياجاتهم، ومساعدتهم على العمل بأنفسهم. يمكن لمعلّمي الذكاء الاصطناعي تقديم دعم إضافي للطلاب، مما يضمن بقاءهم على المسار الصحيح. كما يمكن أن يُغَيّرَ الذكاء الاصطناعي أين وكيف يتعلّم الطلاب، وربما حتى استبدال بعض المعلّمين.

- الذكاء الاصطناعي في مجال المال (AI in finance): إنّ استخدام الذكاء الاصطناعي في تطبيقات التمويل الشخصي، مثل Mint أو Turbo Tax يُعَطّل المؤسسات المالية. تطبيقات كهذه تقوم بجمع البيانات الشخصية وتقديم المشورة المالية. تمّ استخدام برامج أخرى، مثل IBM Watson في عملية شراء منزل. في هذه الأيام تقوم البرمجيات بتنفيذ الكثير من التداول في وول ستريت.

- الذكاء الاصطناعي في القانون (AI in Law): إنّ عمليّة الاكتشاف عن طريق الغربلة الدقيقة للوثائق في القانون غالباً ما تكون متعبة جداً للبشر. أتمتة هذه العملية تُعْتَبَر استخدام أكثر كفاءة للوقت. تقوم الشركات الناشئة أيضاً ببناء مُساعدين مُبَرْمَجِين في مجال "الأسئلة والأجوبة" عن طريق الكمبيوتر، يمكنهم فرز الأسئلة المبرمجة لاستخدامها في عملية الإجابة، وذلك عن طريق فحص التصنيف وعلم الوجود باستخدام قاعدة بيانات مرتبطة.

- الذكاء الاصطناعي في التصنيع (AI in manufacturing): يعتبر هذا المجال هو أول مجال تمّ فيه دمج الروبوتات في عمليات التصنيع. تُسْتَخْدَم الروبوتات الصناعية لأداء مهام فردية وتم فصلها عن العاملين البشر، ولكن مع تقدّم التكنولوجيا يتغيّر ذلك.

الأمان والمخاوف الأخلاقية:

تطبيق الذكاء الاصطناعي في عالم السيارات ذاتية القيادة يثير الأمن وكذلك المخاوف من الناحية الأخلاقية. حيث أنّه يمكن اختراق السيارات، بالإضافة إلى أنّه عندما تقع سيارة ذاتية القيادة في حادثٍ ما، تكون المسؤولية عندها غير واضحة. يمكن أيضاً أن تقع المركبات "ذاتية القيادة" في موقف لا يمكن تجنب وقوع حادث فيه، مما يجبر البرمجة على اتخاذ قرار أخلاقي حول كيفية تقليل الضرر.

مصدر قلق رئيسي آخر هو احتمال إساءة استخدام أدوات الذكاء الاصطناعي. بدأ المخترقون (Hackers) في استخدام أدوات "تعلّم الآلة" المعقّدة ليتمكّنوا من الوصول إلى الأنظمة الحساسة، مما يُعَقّد مسألة الأمن خارج حالتها الحالية.

كما تزوّد أدوات إنشاء مقاطع الفيديو والصوت المعتمدة على "التعلّم العميق" الأشخاص السيئين بالأدوات اللازمة لإنشاء ما يسمى "التزييف العميق" (Deepfake)، بحيث يستطيعون إنشاء مقاطع فيديو مُلَفَّقَة بشكل مقنع جداً لشخصيات عامة مشهورة تظهر على أنّها تقول أو تفعل أشياء لم تحدث أبداً.

تنظيم تكنولوجيا الذكاء الاصطناعي:

على الرغم من هذه المخاطر المحتملة، هناك عدد قليل من اللوائح التي تحكم استعمال أدوات الذكاء الاصطناعي، وحيثما توجد القوانين، فالأمر المتعلّق بالذكاء الاصطناعي عادةً يكون بشكل غير مباشر فقط. على سبيل المثال، تتطلب لوائح الإقراض العادل الفيدرالية من المؤسسات الماليّة أن تشرح القرارات الائتمانية للعملاء المحتملين، وهذا بالتالي يَحُدُّ من مدى إمكانية استخدام المُقْرِضِين لخوارزميات "التعلّم العميق"، والتي بطبيعتها تكون مُبْهَمَة. يضع "النظام الأوروبي العام لحماية البيانات" قيوداً صارمة على كيفية قيام المؤسسات باستخدام بيانات المستهلك، مما يعوق التدريب والوظائف في العديد من تطبيقات الذكاء الاصطناعي التي تواجه المستهلك.

أضف تعليقاً